Difference between revisions of "Google Cloud"

Adelo Vieira (talk | contribs) |

Adelo Vieira (talk | contribs) |

||

| (2 intermediate revisions by the same user not shown) | |||

| Line 1: | Line 1: | ||

| − | + | * [[Media:Interacting_with_the_GCP-CA2_Cloud.pdf]] | |

| + | |||

| + | * [[Media:PowerShell_and_GoogleCloud.pdf]] | ||

| + | <br /> | ||

==Google Cloud Platform== | ==Google Cloud Platform== | ||

https://console.cloud.google.com | https://console.cloud.google.com | ||

| Line 498: | Line 501: | ||

===Setting up IIS web site on Google cloud=== | ===Setting up IIS web site on Google cloud=== | ||

[[Media:Setting_up_IIS_web_site_on_Google_cloud-Michael2018.pdf]] | [[Media:Setting_up_IIS_web_site_on_Google_cloud-Michael2018.pdf]] | ||

| + | |||

| + | |||

| + | <br /> | ||

| + | ===Autoscaling using a scripted template=== | ||

| + | /home/adelo/1-system/1-disco_local/1-mis_archivos/.stockage/desktop-dis/it_cct/2-System_Management_and_Provision/0-2-CA-HWs/0-CA2/latex_report/1-master.pdf | ||

| + | |||

| + | * First, we created an instance template. We configure in this template a start-up script that will configure the VM to host a basic Web page: | ||

| + | :* In the GCP: Compute Engine > Instance templates | ||

| + | <blockquote> | ||

| + | <syntaxhighlight lang="java"> | ||

| + | #!/bin/bash | ||

| + | apt-get update -y | ||

| + | apt-get install apache2 -y | ||

| + | apt-get install php7.0 -y | ||

| + | sudo gsutil cp -r gs://wonderful-bucket-2017279/DigiTech /var/www/html | ||

| + | </syntaxhighlight> | ||

| + | </blockquote> | ||

| + | |||

| + | |||

| + | * Then, we created 2 instance groups. One in a Europe region and another in a US region: | ||

| + | :* Multiple zones | ||

| + | :* Instance template: The template previously created. | ||

| + | :* Autoscaling metrics (Use metrics to determine when to autoscale the group): 60% CPU utilization | ||

| + | :* Autohealing Health check: | ||

| + | ::* Protocol: TCP | ||

| + | ::* Port: 80 | ||

| + | ::* Check interval: 10 segs | ||

| + | ::* Timeout: 5 segs | ||

| + | ::* Healthy threshold: 2 consecutive successes | ||

| + | ::* Unhealthy threshold: 3 consecutive failures | ||

| + | |||

| + | |||

| + | * When the instance group detects, through the Health check, that a new instance must be created, a new VM instance will be provisioned using the instance template. As configured in the instance template, When the VM is created it runs the start-up script and rapidly provisions the VM to host our web site. | ||

| + | |||

| + | |||

| + | * This Automation saves us time, especially if we have many VMs we can use the script for Automation as we see in the Autoscaling. | ||

| + | |||

| + | |||

| + | * To examine the correct operation of the autoscaling, on Unix/Linux system, the «stress» command can be used to put the system under a specified load: | ||

| + | <blockquote> | ||

| + | <syntaxhighlight lang="java"> | ||

| + | sudo stress --cpu 8 --timeout 20 | ||

| + | </syntaxhighlight> | ||

| + | </blockquote> | ||

<br /> | <br /> | ||

Latest revision as of 11:05, 28 May 2020

Contents

- 1 Google Cloud Platform

- 1.1 Pricing

- 1.2 CA2-Interacting with the GCP

- 1.3 Cloud SDK: Command-line interface for Google Cloud Platform

- 1.4 Crear una VM Instance

- 1.5 Crear storage

- 1.6 Connecting to Instances

- 1.7 Copy files

- 1.8 Acceding Cloud Storage buckets

- 1.9 Mounting Cloud Storage buckets as file systems

- 1.10 Firewall Rules

- 1.11 Service Accounts

- 1.12 Live Migration of a Virtual Machine

- 1.13 Live migration of a desktop computer

- 1.14 Create Bitnami WordPress Site on Google Cloud

- 1.15 Setting up IIS web site on Google cloud

- 1.16 Autoscaling using a scripted template

Google Cloud Platform

https://console.cloud.google.com

para ver la Amount remaining del Promotion value of 243.35: Principal Menu (Burger) > Billing > Overview

Lo primero que tenemos que hacer es crear un proyecto. Generalmente hay un proyecto by default llamado «My First Project». Para crear un nuevo proyecto debemos ir a la pestaña que se encuentra justo al lado del Main Menu (Hamburger).

Pricing

- 1 shared vCPU, 0.6 GB RAM, 50GB Storage: 70.56 $/year

- 1 shared vCPU, 1.7 GB RAM, 50GB Storage: 189.6 $/year

CA2-Interacting with the GCP

Media:Interacting_with_the_GCP-CA2_Cloud.pdf

- Creating a storage bucket. Uploading items from a host computer using the command line and the GUI and place them into the bucket

- Using the command line

- Using the GUI

- Upload items from the bucket to a Linux virtual machine using the Google CLI

- Creation of a Linux VM, installing Apache and uploading the web page to the web site

- Create a Linux VM, install NGINX and upload the web page to the web site

- Create a Windows VM, install IIS and upload the web page to the web site

- Live Migration of a VirtualBox VM to the GCP

- Explain what Live Migration is and identify situations where DigiTech could benefit from it

- Research topic: Other services available from Google’s Cloud Launcher

- Python tutorial

- Challenging research topic - GCSFUSE: It allows you to mount a bucket to a Debian Linux virtual machine

- Installing Cloud Storage FUSE and its dependencies

- Mounting a Google Cloud Storage Bucket as a local disk

- Change the root directory of an apache server

Cloud SDK: Command-line interface for Google Cloud Platform

The Cloud SDK is a set of tools for Cloud Platform. It contains gcloud, gsutil, and bq, which you can use to access Google Compute Engine, Google Cloud Storage, Google BigQuery, and other products and services from the command-line. You can run these tools interactively or in your automated scripts. A comprehensive guide to gcloud can be found in gcloud Overview.

Instalación

El proceso de instalación se encuentra detallado en https://cloud.google.com/sdk/

Logré instalarlo correctamente a través de la opción: Install for Debian / Ubuntu: https://cloud.google.com/sdk/docs/quickstart-debian-ubuntu

La procesimiento de instalación general para Linux: https://cloud.google.com/sdk/docs/quickstart-linux generó errores en mi sistema y no se pudo completar la instalación.

Initialize the SDK

https://cloud.google.com/sdk/docs/quickstart-linux

Luego de instalar SDK, debemos usar the gcloud init command to perform several common SDK setup tasks. These include:

- Especificar la user account (adeloaleman@gmail.com): authorizing the SDK tools to access Google Cloud Platform using your user account credentials

- Setting up the default SDK configuration:

- El proyecto (creado en al GCP) al que vamos a acceder by default

- ...

gcloud init

Crear una VM Instance

Main Menu (Hamburger) > Compute Engine > VM instances:

- Create Instance

Linux VM Instance

- Name: debian9-1

- Zone: Lo lógico es elegir la zona donde te encuentras, aunque si elijes alguna otra no habrá mucha diferencia (el precio varía dependiendo de la zona)

- Elegiremos la primera zona de West Europe propuesta: europe-west4-a

- Machine type: Is customize. Las características por defecto son:

- 1vCPU / 3.75 GB memory

- Las características más básicas son:

- micro (1 shared vCPU 0.6GB memory) (el precio baja considerablemente si elegimos éste) (para Linux podría ser suficiente)

- Container: Deploy a container image to this VM instance.

- Ver Containers

- No es, por ahora, necesario activar esta opción para nuestro propósito de prueba.

- Boot disk:

- OS: La opción por defecto es Debian GNU/Linux 9 (stretch). Vamos estar trabajando con éste.

- Disk size: 10GB por es la opción por defecto para Linux.

- Identity and API access :

- Service account: Esta opción se encuentra ajustada a "Compute Engine Default Service Account".

- Access scopes:

- Allow default access: Activada por defecto...

- Allow full access to all Cloud APIs

- Es apropiado marcar esta opción. Si no se marca no se podrá, por ejemplo, copiar files desde una VM instance a un bucket de esta forma:

gsutil cp file.txt gs://adelostorage/

- Otra opción es para permitir copiar archivos desde la VM hacia un bucket es configurar la "Service account". Debemos elegir una Service Account que hayamos configurade previamente para permitir este tipo de acciones. Ver Service Accounts para más detalles

- Set access for each API

- Firewall:

- Add tags and firewall rules to allow specific network traffic from the Internet

- Allow HTTP traffic: Activaremos esta opción to be able to maange the site through an SSH connection.

- Allow HTTPS traffic: Activaremos esta opción to be able to maange the site through an SSH connection.

- Management, disks, networking, SSH keys: Este link nos da la opción de realizar muchas otras configuraciones. Dejaremos todo por defecto por ahora.

Crear storage

Create a storage bucket:

Main Menu > Storage > Browser:

- Create bucket:

- Name: mi_storage-1

- Default storage class: Vamos a dejar la opción by default -- Multi-Regional

- Location: Europe

Connecting to Instances

https://cloud.google.com/compute/docs/instances/connecting-to-instance

Compute Engine provides tools to manage your SSH keys and help you connect to either Linux and Windows Server instances.

Connecting to Linux instances

You can connect to Linux instances through either:

- The Google Cloud Platform Console

- The gcloud command-line tool.

- Connecting using third-party tools

Compute Engine generates an SSH key for you and stores it in one of the following locations:

- By default, Compute Engine adds the generated key to project or instance metadata.

- If your account is configured to use OS Login, Compute Engine stores the generated key with your user account.

The Google Cloud Platform Console

Esta es un Console que pertenece a la GCP a la cual se accede a travé de una Browser window. Para abrirla vamos a:

- In the GCP (Google Cloud Platform) Console, go to the VM Instances page.

- In the list of virtual machine instances, click SSH in the row of the instance that you want to connect to.

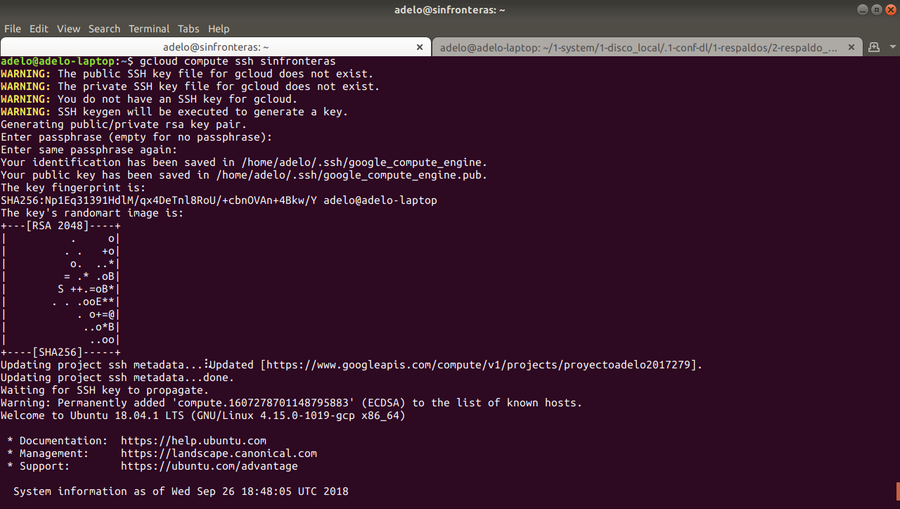

The gcloud command-line tool

A través del comando gcloud (incluido en Cloud SDK) podemos acceder a la VM Instance desde el Terminal (Console) de nuestra computadora.

gcloud compute ssh [INSTANCE_NAME]

Connecting using third-party tools

https://cloud.google.com/compute/docs/instances/connecting-advanced#thirdpartytools

Ver Linux#SSH

También podemos acceder a una VM Instance sin necesidad de utilizar herramientas de la GCP, como lo son The Google Cloud Platform Console or gcloud. Podemos, en su lugar, utilizar SSH.

Luego de crear una VM Instance, no podremos acceder a la VM a través de SSH debido a que ningún método de autentificación estará disponible. Como explicamos en Linux#SSH. Hay dos approach para la autentificación al usar SSH:

- Using the password de la «cuenta linux»:

- Las Google Cloud VM Instance se crean por defecto sin password. Además, en la configuración por defectos de las Google VM Instance, se impide la autentificación con password. Es decir, el archivo «/etc/ssh/sshd_config» presenta la siguiente configuración: «PasswordAuthentication no».

- Entonces, tenemos primero que encontrar otro método de acceder a las GC VM para:

- Configurar «PasswordAuthentication yes»

- Configurar un password para el user@VMInstance

- SSH Keys: Si queremos autentificar la conexión con este método tenemos primero que copiar la «public key» de nuestra computadora en las Google Cloud VM Instances.

- Como se explica en Linux#SSH, si queremos hacerlo con el comando «ssh-copy-id» tenemos primero que configurar una password para el user@VMInstance y habilitar la autentificación a través de dicho password como explicamos arriba.

- Entonces, igualmente, tenemos primero que encontrar otro método de acceder a las GC VM para poder copiar la «public key».

Alors, para conectarnos a las GC VM y realizar las configuraciones necesarias para permitir la conexión con SSH podemos usar el comando «gcloud» como ya hemos visto:

gcloud compute ssh [INSTANCE_NAME]

Cuando realizamos la primera conexión a través de «gcloud», el comando generará las keys necesarias para la conexión con «gcloud»:

Lo que he constatado es que, luego de crear la GC VM, si intento ingresar con «ssh» antes de haber ingresado con «gcloud», no será posible el acceso porque no hay método de autentificación. Sin embargo, si primero me conecto con «gcloud», luego sí puedo ingresar con «ssh» sin necesidad de realizar otra configuración ni copiar la «public key». Esto me imagino que es porque, como se ve en la imagen mostrada arriba, «gcloud» ha creado las «key» y copiado la «public key» en la computadora destino; y al parecer éstas mismas funcionan con una conexión normal de ssh (sin acudir a «gcloud»). Esto lo he constatado conectandome desde mi computadora a las GC VM. Sin embargo, siguiendo el mismo procedimiento intenté conectarme entre dos GC VM Instances y no logré estableser la conección a través de SSH. El problema lo solucioné, siguiendo el consejo de un forum, borrando todos los archivos en «~/.ssh/» excepto «known_hosts» y generando nuevas keys (con «ssh-keygen») y copiando la nueva «public key» en la GC VM correspondiente, siguiendo los procedimientos en Linux#SSH.

Copy files

From the host computer to a bucket on Google Cloud

Luego de crear el bucket, podemos copiar archivos al bucket. Hay diferentes formas de hacerlo:

- Sinple drag and drop

- Usando el terminal de Google cloud

- Desde el terminal de la computadora luego de instalar Cloud SDK

Desde el terminal de la computadora luego de instalar Cloud SDK

El siguiente comando copia un archivo que está en mi computadora a un bucket on GC:

gsutil cp probando gs://adelostorage

Where adelostorage is the name of the bucket.

From the host computer to a Linux VM Instance or between VM's

https://cloud.google.com/sdk/gcloud/reference/compute/scp

To copy a remote directory, ~/narnia, from example-instance to the ~/wardrobe directory of your local host, run:

gcloud compute scp --recurse example-instance:~/narnia ~/wardrobe

From a bucket to an VM Instance

Luego de acceder a una VM Instance, puedo copiar un archivo desde un bucket a dicha VM Instance a través de la siguiente orden:

gsutil cp gs://adelostorage/probando.txt .

Acceding Cloud Storage buckets

He estado buscando una forma para acceder a mis Buckets de forma tal que sea posible compartir el bucket con otras personas:

- A través de una URL

- A través de un IP

En los siguientes links se explica como hacer el bucket público y como acceder a él a través de una URL:

- https://cloud.google.com/storage/docs/access-control/making-data-public

- https://cloud.google.com/storage/docs/access-public-data

Pensé que lo que se explicaba en esos links era la solución. Pero creo que eso sólo permite hacer el bucket público para todos los usuarios de un proyecto (creo); porque la URL a la que creo se refieren en dicho link es:

- https://console.cloud.google.com/storage/BUCKET_NAME

- En mi caso: https://console.cloud.google.com/storage/browser/sinfronterasbucket1

y pues ese link sólo permitiría el acceso a mi bucket al estar logeados en mi cuenta.

Connecting your domain to a Cloud Storage Bucket

Lo que sí encontré es que hay una forma de asociar el bucket a un dominio que nos pertenezca. Por ejemplo, el siguiente subdominio lo voy a asociar a un bucket:

- www.es.sinfronteras.ws

- https://console.cloud.google.com/storage/browser/www.es.sinfronteras.ws

En el siguiente link se explica como connect your domain to Cloud Storage and Hosting a Static Website en el Bucket: https://cloud.google.com/storage/docs/hosting-static-website

Mounting Cloud Storage buckets as file systems

Cloud Storage FUSE: Mounting Cloud Storage buckets as file systems on Linux or OS X systems: https://cloud.google.com/storage/docs/gcs-fuse

Cloud Storage FUSE is an open source FUSE adapter that allows you to mount Cloud Storage buckets as file systems on Linux or OS X systems.

Installing Cloud Storage FUSE and its dependencies

https://github.com/GoogleCloudPlatform/gcsfuse/blob/master/docs/installing.md

- Add the gcsfuse distribution URL as a package source and import its public key:

export GCSFUSE_REPO=gcsfuse-`lsb_release -c -s` echo "deb http://packages.cloud.google.com/apt $GCSFUSE_REPO main" | sudo tee /etc/apt/sources.list.d/gcsfuse.list curl https://packages.cloud.google.com/apt/doc/apt-key.gpg | sudo apt-key add -

- Update the list of packages available and install gcsfuse:

sudo apt-get update sudo apt-get install gcsfuse

- (Ubuntu before wily only) Add yourself to the fuse group, then log out and back in:

sudo usermod -a -G fuse $USER exit

- Future updates to gcsfuse can be installed in the usual way:

sudo apt-get update && sudo apt-get upgrade

Set up credentials for Cloud Storage FUSE

Cloud Storage FUSE auto-discovers credentials based on application default credentials:

- If you are running on a Google Compute Engine instance with scope storage-full configured, then Cloud Storage FUSE can use the Compute Engine built-in service account. For more information, see Using Service Accounts with Applications.

- Si se está usando una Google Compute Engine Instance, no se tiene que hacer nada para montar el Bucket. Sin embargo si el Access scopes de dicha Instance no fue configurado correctamente, entonces no podremos copiar arechivos desde la Instance hacia el Bucket montado. Ver en la creación de la VM Instance que es apropiado elegir "Allow full access to all Cloud APIs" o elegir una Service Account que hayamos configurade previamente para permitir este tipo de acciones. Ver Service Accounts para más detalles.

- If you installed the Google Cloud SDK and ran gcloud auth application-default login, then Cloud Storage FUSE can use these credentials.

- If you set the environment variable GOOGLE_APPLICATION_CREDENTIALS to the path of a service account's JSON key file, then Cloud Storage FUSE will use this credential. For more information about creating a service account using the Google Cloud Platform Console, see Service Account Authentication.

Mounting a Google Cloud Storage Bucket as a local disk

- Create a directory:

mkdir /path/to/mount

- Create the bucket you wish to mount, if it doesn't already exist, using the Google Cloud Platform Console.

- Use Cloud Storage FUSE to mount the bucket (e.g. example-bucket).

gcsfuse example-bucket /path/to/mount

Es muy importante notar que si montamos el bucket como se muestra arriba, no podremos accederlo a través del Web Brower. Es decir, el Web server no tendrá la permisología para acceder a este directorio.

Esto es un problema si queremos colocar un sitio web en el bucket; al cual se va a acceder a través de la VM Instance.

En este caso, debemos montarlo de la siguiente forma: https://www.thedotproduct.org/posts/mounting-a-google-cloud-storage-bucket-as-a-local-disk.html

sudo gcsfuse -o noatime -o noexec --gid 33 --implicit-dirs -o ro -o nosuid -o nodev --uid 33 -o allow_other mi_storage1 /path/directory/Explaining the mount options:

- ro - mount the volume in read-only mode

- uid=33,gid=33 - grant access to user-id and group-id 33 (usually the web serve user e.g. www-data):

- Your OS has a web server user whose user-id (UID) and groupd-id (GID) are 33

Para desplegar el web server user-id (UID) and groupd-id: http://www.digimantra.com/linux/find-users-uid-gid-linux-unix/

id -u www-data id -g www-data

- noatime - don't update access times of files

- _netdev - mark this as a network volume so the OS knows that the network needs to be available before it'll try to mount

- noexec - don't allow execution of files in the mount

- user - allow non-root users to mount the volume

- implicit_dirs - treat object paths as if they were directories - this is critical and Fuse-specific

- allow_other - allow non-root users to mount (Fuse-specific AFAIK)

- To unmount the bucket:

fusermount -u /home/shared/local_folder/

Firewall Rules

How to open a specific port such as 9090 in Google Compute Engine:

https://cloud.google.com/vpc/docs/using-firewalls

Por defectos, sólo el puerto tcp:80 se encuentra abierto. Los otros están protegidos por los firewalls. Si configuramos, por ejemplo, un Web Server (Apache, NGINX) en un puerto distinto al 80, debemos modificar los Firewall Rules para que el Web Server sea capaz de servir las páginas a través de otro puerto.

Para abrir un puerto:

- Choose you Project: al lado del Main Menu (burguer)

- Then, go to: Burguer > VPC network > Firewall rules:

- Create a firewall rule

Luego, seguir los pasos indicados en: https://cloud.google.com/vpc/docs/using-firewalls: Con las siguientes especificaciones (el resto en default) he sido capaz de hacerlo:

- Targets

- All instances in the network

- Source IP ranges:

- If you want it to apply to all ranges, specify 0.0.0.0/0

- Specified protocols and ports:

- tcp:8080 (para abrir el puerto 8080)

Service Accounts

A service account is a special account whose credentials you can use in your application code to access other Google Cloud Platform services.

Creating and Managing Service Accounts: https://cloud.google.com/iam/docs/creating-managing-service-accounts#creating_a_service_account

Creating and Enabling Service Accounts for Instances: https://cloud.google.com/compute/docs/access/create-enable-service-accounts-for-instances#createanewserviceaccount

Granting Roles to Service Accounts: https://cloud.google.com/iam/docs/granting-roles-to-service-accounts

Por ejemplo, para poder copar arvhivos desde VM Instance hacia un Bucket, you need to Setting up a new instance to run as a service account. Dicha service account tiene que haber sido Granted with the particular Roles que permiten dicha operación de copia.

To grant the roles, no puede hacerlo a través de la línea de comandos pues me generó un error. Lo pude sin embargo hacer desde la página de GCP. para la operación de copia descrita arriba hay que agregar a la service account en la cual corre la VM los roles relacionados con Storage:

- Storage Admin

- Storage Object Admin

- Storage Object Creator

- Storage Object Viewer

Luego de haber creado la Service Account podemos, al momento de crear la VM Instance, ajustar que la new instance runs as this service account (ver ).

Live Migration of a Virtual Machine

- The virtualBox machine that you migrate should be using a VMDK (Virtual Machine Disk), not VDI (VirtualBox Disk Image) or VHD (Virtual Hard Disk).

- Make sure you the NIC (Network Interface Controler) (Network > Adapter 1 > Attached to) is set to NAT so that you have Internet access.

- Es muy importante tomar en cuenta que para podernos conectar (a través de gcloud compute ssh VMmigrada) a la VM Instance luego de haberla migrado, el paquete openssh-server tiene que haber sido previamente instalado en la VM.

Para realizar la migración:

- In the GCP

- Main Menu > Compute engine > VM Instances: Import VM

- There you will be redirected to the Cloud Endure Platform (VM Migration Service)

- In the Cloud Endure Platform (VM Migration Service)

- https://gcp.cloudendure.com

- GCP credentials

- We need to create GCP credentials (Google Cloud Platform JSON private key (JSON file)). To generate a JSON private key file (could be also PKCS12 format) (Creo que estas credenciales cambiarían sólo si queremos realizar una migración hacia otro proyecto):

- Click "Find out where to get these credentials"

- Lo anterior abrirá la página de Documentation with a link to "Open the link of Credentials"

- Then, you need to choose the project: The target project where your VM will be migrate.

- Debemos copiar el Project ID porque luego lo vamos a necesitar en la Cloud Endure Platforme

- Click "Create credentials" and Select "Service Account Key" option

- Select the JSON option (for key type)

- The service account should be "Compute engine default service account"

- Then hit create: the JSON file will be downloaded to your computer.

- Luego, you go back to the Cloud Endure Platform (VM Migration Service)

- Enter the Google Cloud Platform project ID

- Luego cargamos el JSON file (Google Cloud Platform JSON private key). Then "Save".

- Este es el archivo JSON que creé en mi cuenta GC cuando migré mi VM: Media:ProyectoAdelo2017279-78811cb38326.json

- Replication settings

- Live migration target: Google EU West 2 (London)

- Hit Save replication settings

- Luego de esto: Project setup complete Congratulations!

- Your Live Migration Project is set up. So, the next step is to install the CloudEndure Agent on your Source machine.

- Install the CloudEndure Agent on your Source machine

- How To Add Machines: https://gcp.cloudendure.com/#/project/2be028cc-40ae-4215-ad2c-52e3ce4e325d/machines

- In order to add a machine to the GCP, install the CloudEndure Agent on your machine (your VirtualBox VM for example) (data replication (proceso de transferencia de la VM) begins automatically upon CloudEndure Agent installation).

Your Agent installation token: (este código lo genera automáticamente la Cloud Endure Platform (VM Migration Service. No sé si es diferente en cada migración.. Creo podría depender del proyecto; entonces debería cambiar si queremos migrar una VM hacia otro proyecto)

0E65-51C9-50EE-E20E-A583-9709-1653-BA57-457D-92BF-57B9-0DE2-22DC-EA11-3B80-81E6For Linux machines:

Download the Installer:

wget -O ./installer_linux.py https://gcp.cloudendure.com/installer_linux.pyAntes de ejecutar el siguiente paso tuvimos que instalar:

sudo apt-get install python2.7 sudo apt-get install gccThen run the Installer and follow the instructions:

sudo python ./installer_linux.py -t 0E65-51C9-50EE-E20E-A583-9709-1653-BA57-457D-92BF-57B9-0DE2-22DC-EA11-3B80-81E6 --no-promptFor Windows machines:

Download the Windows installer here https://gcp.cloudendure.com/installer_win.exe, then launch as follows:

installer_win.exe -t 0E65-51C9-50EE-E20E-A583-9709-1653-BA57-457D-92BF-57B9-0DE2-22DC-EA11-3B80-81E6 --no-prompt

- Data replication

- Data replication begins automatically once the installation of the CloudEndure Agent is completed. You will see able to see progress on the Cloud Endure Platform (VM Migration Service)

- Data replication es de hecho el proceso en el cual la VM es copiada hacia la GCP.

- Launch target Machine

- Luego de haberse completado la Data replication, se habrá creado una Instance en la página de VM Instace del correspondiente proyecto en la GCP. Esta Instace, cuyo nombre contiene "replicator" no será la VM Instance definitiva. Debemos entonces hacer click en "Launch target Machine" (aún en la Cloud Endure Platform (VM Migration Service)), lo cual generará la VM Instance en la correspondiente página de la GCP. Habrán entonces dos Instance en la Página de la GCP. En mi caso:

- ce-replicator-goo16-20eb5f29

- ubuntu-18932dd6

- Si hacemos cambios en nuestra Local VirtualBox VM, podremos actualizar la correspondiente Google VM Instance fácilmente haciendo click en "Launch target Machine" nuevamente. La ce-replicator-goo16-20eb5f29 creo que tiene la función de actuar en esta actualización.

Live migration of a desktop computer

Migrating your computer to Google Cloud using Cloud Endure

Create Bitnami WordPress Site on Google Cloud

Media:Create_Bitnami_WordPress_Site_on_Google_Cloud-Michael2018.pdf

Setting up IIS web site on Google cloud

Media:Setting_up_IIS_web_site_on_Google_cloud-Michael2018.pdf

Autoscaling using a scripted template

/home/adelo/1-system/1-disco_local/1-mis_archivos/.stockage/desktop-dis/it_cct/2-System_Management_and_Provision/0-2-CA-HWs/0-CA2/latex_report/1-master.pdf

- First, we created an instance template. We configure in this template a start-up script that will configure the VM to host a basic Web page:

- In the GCP: Compute Engine > Instance templates

#!/bin/bash apt-get update -y apt-get install apache2 -y apt-get install php7.0 -y sudo gsutil cp -r gs://wonderful-bucket-2017279/DigiTech /var/www/html

- Then, we created 2 instance groups. One in a Europe region and another in a US region:

- Multiple zones

- Instance template: The template previously created.

- Autoscaling metrics (Use metrics to determine when to autoscale the group): 60% CPU utilization

- Autohealing Health check:

- Protocol: TCP

- Port: 80

- Check interval: 10 segs

- Timeout: 5 segs

- Healthy threshold: 2 consecutive successes

- Unhealthy threshold: 3 consecutive failures

- When the instance group detects, through the Health check, that a new instance must be created, a new VM instance will be provisioned using the instance template. As configured in the instance template, When the VM is created it runs the start-up script and rapidly provisions the VM to host our web site.

- This Automation saves us time, especially if we have many VMs we can use the script for Automation as we see in the Autoscaling.

- To examine the correct operation of the autoscaling, on Unix/Linux system, the «stress» command can be used to put the system under a specified load:

sudo stress --cpu 8 --timeout 20